Навчання ШІ на ШІ загрожує «отруєнням даних»

Критична проблема сучасної індустрії штучного інтелекту — «отруєння даних» синтетичним контентом. Це значить, що ШІ навчається на даних, згенерованих іншим ШІ, або навіть тим самим, з мінімальним людським втручанням.

Проблема «цифрового інцесту» та деградація моделей

Основна проблема штучного інтелекту полягає в тому, що коли ШІ-моделі навчаються на контенті, який був згенерований іншими ШІ-системами, продуктивність моделі неминуче деградує з кожним новим циклом. Експерти називають цей процес «отруєнням даних з метою зручності». Організації, прагнучи прискорити цифрову трансформацію, наповнюють свої бази даних автоматично створеними звітами, листами та кодом. Як наслідок, наступне покоління моделей навчається не на реальному людському досвіді, а на «копії копії».

Чотири ключові загрози для бізнесу

1. Обвал співвідношення «сигнал-шум»

Деніел Кімбер, CEO Brainfish AI, зазначає, що синтетичний контент розмиває тонкий інституційний контекст та приватні випадки, які є основою людських знань. Коли модель втрачає зв’язок із реальністю, вона починає оперувати абстракціями, що призводить до втрати точності в прийнятті бізнес-рішень.

2. Ілюзія компетентності

Це одна з найпідступніших проблем. ШІ зберігає високу «мовну вправність» (fluency), тобто його відповіді звучать впевнено та логічно, проте фактична точність стрімко знижується. Традиційні тести часто не помічають цього перекосу, оскільки модель продовжує генерувати граматично правильний і стилістично вивірений текст, який водночас містить фактичні помилки або шкідливий код.

3. Гомогенізація та зникнення нюансів

Навчання на синтетичних даних призводить до «усереднення» результатів. Зникають рідкісні знання, що знаходяться у «хвостах» розподілу даних. У юридичній чи медичній сферах це може проявлятися у викривленні хронології подій або ігноруванні критично важливих дрібниць, що несе прямі юридичні ризики.

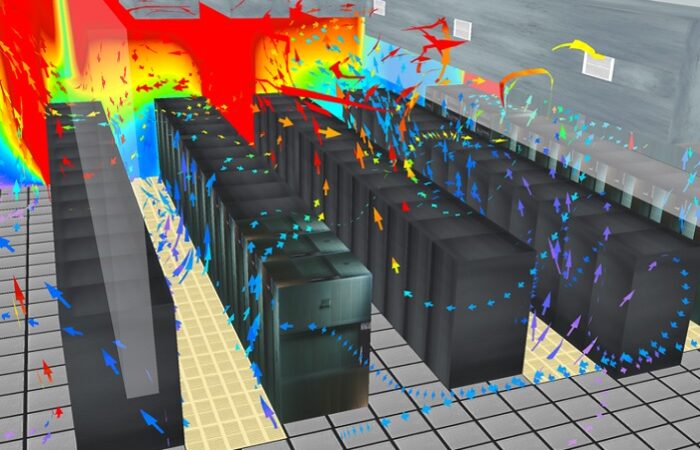

4. Економічні та технічні наслідки

Неточності в оцінці ресурсів або маркуванні даних накопичуються непомітно, але одномоментно можуть призвести до збоїв у інфраструктурі чи значного зростання витрат на хмарні обчислення. Інструменти для аналізу коду, навчені на синтетиці, починають пропонувати робочі шаблони, які містять приховані вразливості безпеки.

Рекомендації експертів

Згідно з дослідженнями, опублікованими у Nature, деградація даних, викликана таким отруєнням, є практично незворотною. Єдиний перевірений спосіб запобігти краху моделі — це сувора гігієна даних:

- Завжди накопичувати та зберігати реальні людські дані разом із синтетичними.

- Ніколи не замінювати автентичний контент синтетичним у процесах донавчання (fine-tuning).

- Впроваджувати складніші системи контролю якості, які оцінюють не лише форму, а й фактичну суть відповідей.

Експерти застерігають: прагнення до швидкості та зручності сьогодні може підірвати майбутнє ШІ-технологій у компанії, перетворивши потужний інтелектуальний інструмент на джерело непередбачуваних помилок.

Раніше ми писали, що бум штучного інтелекту є потенційно небезпечним.