Дослідження: детектори фейкових фото та відео часто не здатні виявити згенерований контент

З розвитком генеративного ШІ стає дедалі складніше відрізнити справжні фото та відео від штучно створених. Оскільки сучасні моделі штучного інтелекту генерують візуальний контент з таким рівнем деталізації, що він часто виглядає реально, традиційні підходи розпізнавання дедалі частіше не дають однозначної відповіді, що є справжнім, а що − згенерованим ШІ.

Журналісти The New York Times провели понад 1000 тестів різних інструментів розпізнавання фейкових фото і встановили, що навіть сучасні детектори можуть мати суттєві помилки — вони іноді знаходять сильні сигнали штучного походження, але водночас часто не можуть надати 100 % точність. Це означає, що визначати походження зображень чи відео стає дедалі складніше, особливо коли генеративні моделі створюють контент, який майже не відрізнити від реального.

Однак тестування показало, що такі інструменти краще детектували реальні зображення та згенеровані аудіозаписи.

Притому й людське око самостійно все частіше не здатне надійно розпізнати фейковий контент, оскільки моделі генерують відео і фото з дуже високою якістю та візуальним реалізмом. Це викликає побоювання щодо потенційного поширення дезінформації та маніпуляцій, оскільки відео або зображення, які виглядають достовірно, можуть бути повністю синтетичними.

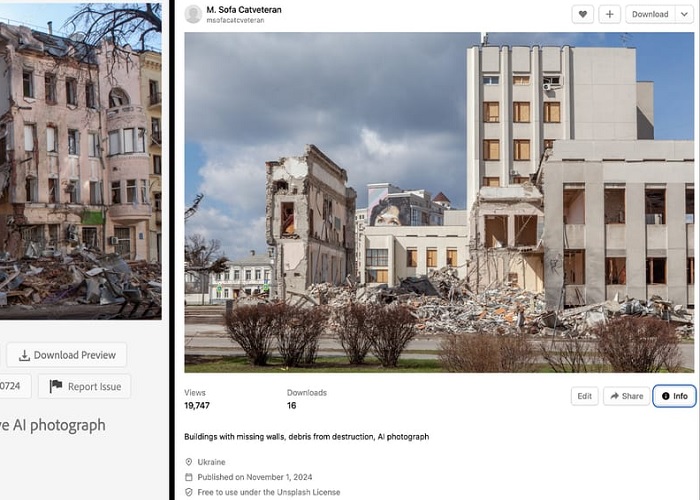

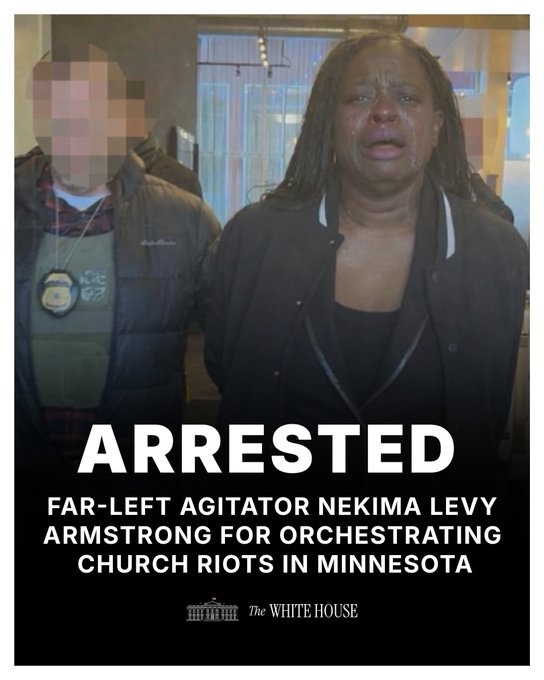

Окрема проблема − виявлення ретушованих реальних зображень. Адже деякі підробки можуть поєднувати реальний контент із медіа, згенерованими штучним інтелектом. Наприклад, Білий дім минулого місяця опублікував змінене зображення жінки, яку минулого місяця заарештували в Міннеаполісі. На фото ця жінка зображена зі страждаючим обличчям, насправді цей вираз обличчя був згенерований ШІ. Однак більшість детекторів штучного інтелекту вважали, що змінене зображення є справжнім, і лише декілька визнали, що воно було відредаговане.

В якості висновку експерти наголошують, що для боротьби з проблемою фейків необхідні нові, більш досконалі технічні засоби детекції. Також важливі інтеграція метаданих й прозоре маркування контенту, які могли б допомогти користувачам і платформам відрізняти справжні медіа від штучно створених.

Це особливо важливо, бо з початку вторгнення РФ до Криму в 2014 році і зараз російські спецслужби використовують тактику дезінформації, щоб послабити міжнародний тиск. Фотореалістичні зображення руйнувань, створені за допомогою штучного інтелекту, стали зброєю в інформаційній війні проти відповідальності. ФСБ генерує сотні таких зображень, вкидає їх в публічний простір, але потім виявляється, що вони штучно створені. А це значить, що такі зображення не можна використовувати як доказ злочинної діяльністі російської армії. Тому для ЗМІ дуже важливо публікувати тільки реальні фото військових подій.

Нещодавно ми писали, що бум штучного інтелекту є потенційно небезпечним.